Da un grande potere derivano grandi responsabilità. Prendiamo a prestito non caso le parole di un supereroe, per analizzare una delle grandi sfide nell’era dell’AI. Una rivoluzione tecnologica in corso, che in Italia vale 1,8 mld di euro e che si sta rapidamente integrando nelle scienze della vita. Con il rischio però che l’automazione da strumento di supporto, “si trasformi in una delega epistemica silenziosa, capace di erodere il giudizio umano, la responsabilità professionale e la qualità della conoscenza scientifica”.

Ne sono convinti Francesco Branda e Massimo Ciccozzi, due dei ‘tre moschettieri dell’epidemiologia’ ideatori del gruppo di ricerca Gabie e scienziati dell’Università Campus Bio-Medico, che in un paper in uscita su ‘Artificial Intelligence in Life Sciences’, affrontano uno dei nodi più delicati dell’integrazione dell’AI, proponendo di ricorrere a quella che definiscono “sovranità cognitiva”. Ma di che si tratta?

La strategia chiave

Per i ricercatori sovranità cognitiva è “la capacità di individui e istituzioni di mantenere il controllo sui processi di valutazione, verifica e decisione in ambienti saturi di AI, senza sostituire il ragionamento umano con l’accettazione automatica degli output algoritmici”.

Se è plausibile non sempre è corretto

Partendo da una ricognizione critica della letteratura su bias e allucinazioni dell’AI, fiducia nei sistemi automatizzati, spiegabilità e governance dell’intelligenza artificiale, Branda e Ciccozzi propongono dunque un’originale chiave interpretativa unificante.

Il lavoro mostra come molti sistemi di AI, soprattutto quando integrati stabilmente nei workflow clinici e di ricerca, tendano a produrre risultati altamente plausibili ma non necessariamente corretti. In questi contesti, spiegano gli autori, l’efficienza e l’autorità percepita dei modelli favoriscono fenomeni di “over-reliance, deskilling e riduzione della vigilanza critica”. Il problema non è solo tecnico, ma culturale e organizzativo, rinforzato da incentivi istituzionali, carichi cognitivi elevati e pressioni di produttività. Insomma, chi avrà più tempo per controllare, quando invece delegare all’AI è così semplice ed economico?

Vigilare sempre

Lo studio di Ciccozzi e Branda analizza il quadro regolatorio emergente, dall’AI Act europeo alle linee guida Fda, Ema e Oms, evidenziandone un presupposto implicito: che la supervisione umana sia sempre disponibile e cognitivamente integra. Al contrario, il lavoro sostiene che la vigilanza epistemica non può essere data per scontata, ma deve essere “progettata, formata e sostenuta nel tempo”.

In questa prospettiva vengono discussi anche strumenti tecnici e concettuali, come modelli ibridi, XAI e perfino quelli che gli autori chiamano indicatori di sovranità cognitiva: non soluzioni automatiche ma come supporti a un giudizio umano attivo.

Il rischio più grande? Non è l’errore dell’AI

Per Francesco Branda “il rischio più grande non è che l’AI sbagli, ma che smettiamo di accorgerci quando sbaglia. Quando l’output algoritmico diventa un default operativo, il pensiero critico si spegne senza che nessuno se ne assuma la responsabilità”.

Un tema che, stando a Massimo Ciccozzi, è particolarmente cruciale nelle scienze della vita: “Qui l’errore non è mai astratto. Un modello biologico sbagliato, una previsione clinica non verificata, una pipeline computazionale non riproducibile – avverte – hanno conseguenze reali. L’automazione non può diventare un alibi epistemico”.

Insomma, spiegabilità, trasparenza e accountability, pur necessarie, non sono sufficienti se non accompagnate da competenze, tempo e incentivi per esercitare un controllo reale. “La sovranità cognitiva non è una virtù individuale, ma un obiettivo di governance: riguarda il modo in cui formiamo i professionisti, progettiamo i sistemi e valutiamo le decisioni”, chiarisce Branda.

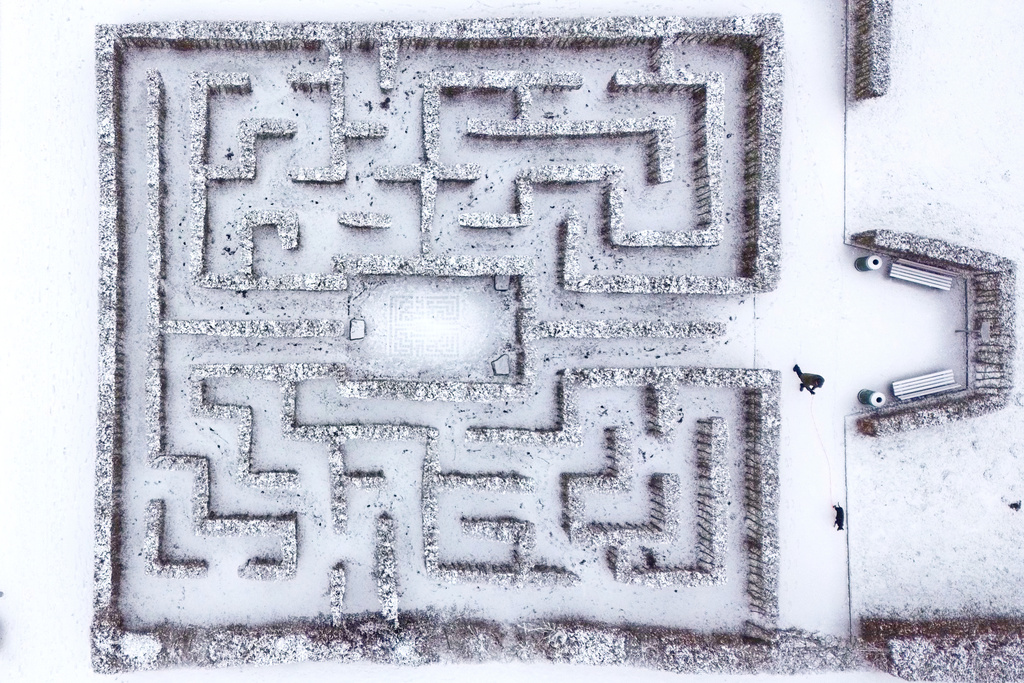

La trappola della nuova zona di comfort

Il futuro dell’intelligenza artificiale nelle scienze della vita non dipenderà solo dalla potenza dei modelli, ma soprattutto dalla capacità di preservare il ruolo dell’essere umano come garante ultimo. “Il comfort dell’automazione è seducente, ma la scienza non nasce dal comfort. Nasce dal dubbio, dalla verifica e dalla fatica di capire”, concludono gli autori alludendo a un percorso arduo e storicamente pieno di insidie e vicoli ciechi. L’AI potrà aiutarci a ridurli, ma dobbiamo ricordare di tenere sempre con mano salda il filo per uscire da questo nuovo labirinto, affinché non si trasformi in una trappola.