Il fatto che Anthropic abbia annunciato Claude for Healthcare pochi giorni dopo ChatGPT Salute è il segnale plastico di una rivoluzione in cui nessuno vuole restare indietro. Ma c’è di più: Francesco Branda, ricercatore dell’Università Campus Bio-Medico e fresco socio della Società europea per l’etica e la politica dell’intelligenza artificiale (Sepai), è convinto che “la prossima grande sfida sarà cambiare identità all’AI, a partire dal nome, attribuendole il peso e il significato che merita, cioè un sistema statistico avanzato che funziona solo grazie alla progettazione umana, e non un’entità autonoma”.

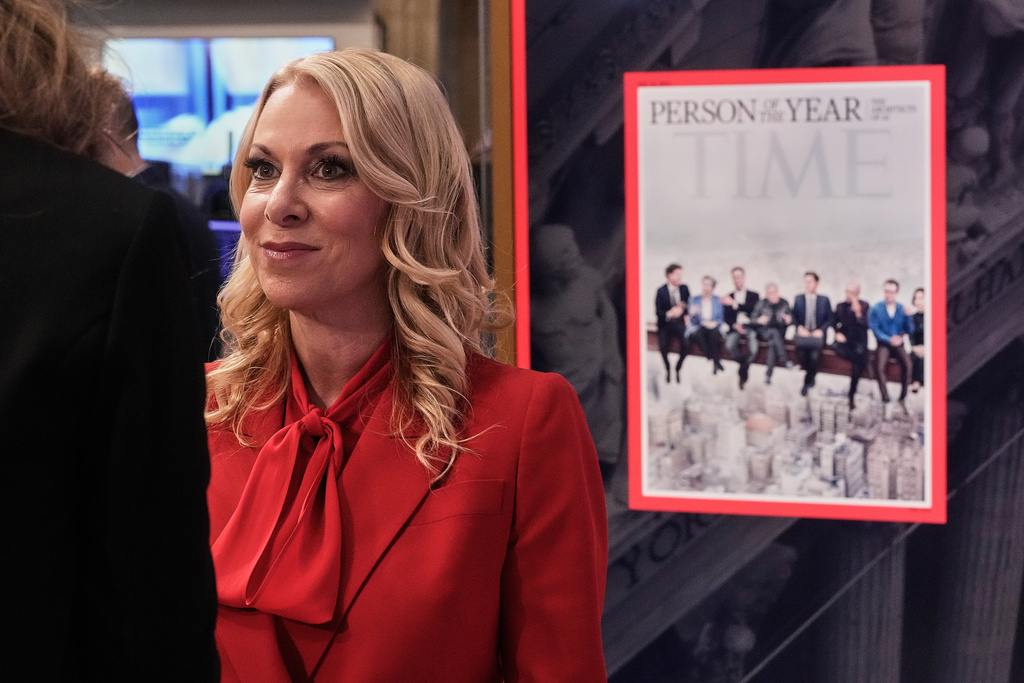

Non facciamoci ingannare: l’AI non è intelligente in senso umano. La riflessione dello scienziato parte dalla scelta del Time di eleggere gli Architetti dell’intelligenza artificiale (AI) Persona dell’anno 2025.

Una scelta che è “la fotografia di un momento storico in cui la tecnologia non è più un ausilio, ma un attore centrale nel definire il presente e il futuro della società”, dice lo studioso. Ormai l’AI non è più confinata al laboratorio, ma ha invaso ogni settore. Dalla medicina alla ricerca scientifica, dalla comunicazione alle infrastrutture sociali, sta ridefinendo la nostra società.

L’impatto in sanità e la questione etica

“In ambito sanitario l’impatto è tangibile: diagnosi più rapide e precise, trattamenti personalizzati, anticipazione dei focolai epidemici e ottimizzazione delle risorse ospedaliere. È la conferma che ciò che fino a pochi anni fa sembrava sperimentale oggi è parte integrante della pratica clinica e della ricerca biomedica. Ma la scelta di Time invita anche a una riflessione più profonda, quasi inquietante. L’AI non è un semplice strumento, è un catalizzatore di potere, conoscenza e responsabilità”, dice Branda.

“Le sue capacità di elaborare enormi quantità di dati, generare previsioni e suggerire soluzioni in pochi secondi, compiti che in passato richiedevano mesi o anni di lavoro umano, pongono interrogativi cruciali: fino a che punto possiamo delegare decisioni complesse a sistemi intelligenti? Quali equilibri etici e sociali dobbiamo stabilire? E soprattutto, come garantire che questa tecnologia amplifichi l’umanità e non la sostituisca?”, si (e ci) chiede il ricercatore.

Un nome fuorviante

“Il termine intelligenza artificiale è fuorviante. Chi ne parla come se fosse dotata di coscienza, comprensione o intuizione commette un errore concettuale che può avere conseguenze concrete. L’AI non è intelligente nel senso umano, non prova empatia, non comprende le sfumature, non ha esperienza”, puntualizza Branda. “È un’interfaccia statistica sofisticatissima, capace di analizzare dati, riconoscere pattern, generare previsioni e suggerire decisioni. Ma resta uno strumento, potentissimo sì, ma pur sempre un mezzo”.

Riconoscere questo “significa riaffermare la centralità dell’uomo. Il Test di Turing, spesso evocato come misura dell’intelligenza artificiale, non deve essere letto come un traguardo che rende la macchina “umana”, bensì come un promemoria della nostra responsabilità”, riflette lo scienziato.

L’umanità

“La macchina può ingannare l’osservatore convincendolo di capire o ragionare, ma l’umano rimane l’arbitro ultimo, colui che attribuisce significato, giudizio e responsabilità a ogni azione della macchina. In medicina, questo principio è vitale: un algoritmo può suggerire diagnosi o strategie terapeutiche, ma non può sostituire l’esperienza clinica, l’intuizione basata su anni di pratica, e soprattutto il contatto umano con il paziente”, chiarisce.

Ma la sfida non si esaurisce qui. “L’AI può essere uno strumento straordinario, ma il suo potenziale si realizza solo se chi la utilizza sa farlo con consapevolezza, competenza e responsabilità. Bisogna guidare le persone a un uso sapiente, a comprendere i limiti e i rischi, a non cedere all’illusione che la macchina possa sostituire la riflessione critica o il giudizio morale”.

Per Branda la sfida educativa è quindi doppia: formare “professionisti in grado di sfruttare le capacità di questa tecnologia senza esserne sopraffatti e creare cittadini capaci di interagire in modo consapevole, critico ed etico”.

Architetto di scenari futuri

Ma attenzione, la copertina di Time ci ricorda anche che “la tecnologia avanza più rapidamente della nostra capacità di comprenderne le implicazioni sociali, etiche e politiche. L’AI non è solo il protagonista delle rivoluzioni presenti, è l’architetto di scenari futuri. La sua capacità di anticipare focolai epidemici, prevedere la diffusione di varianti virali e supportare decisioni strategiche nella gestione delle emergenze sanitarie la rende uno strumento essenziale per affrontare le sfide poste dalla mobilità globale, dai cambiamenti climatici e dalle malattie emergenti”.

Con un forte monito: “Il timone resta in mano all’uomo. Senza una guida etica, senza un progetto umano che dia senso e finalità, la macchina rischia di diventare un automa potente ma cieco, capace di produrre risultati ma incapace di giudicare il loro valore”, ribadisce Branda.

Insomma, nel 2026 la sfida non è più solo tecnologica, ma “sociale, culturale ed educativa. Cambiare identità all’AI, comprenderne la reale natura, riaffermare la centralità dell’uomo e guidare le persone a un uso sapiente e consapevole della tecnologia: solo così – conclude – la promessa del futuro potrà trasformarsi in un progresso sostenibile, equo e umano”.