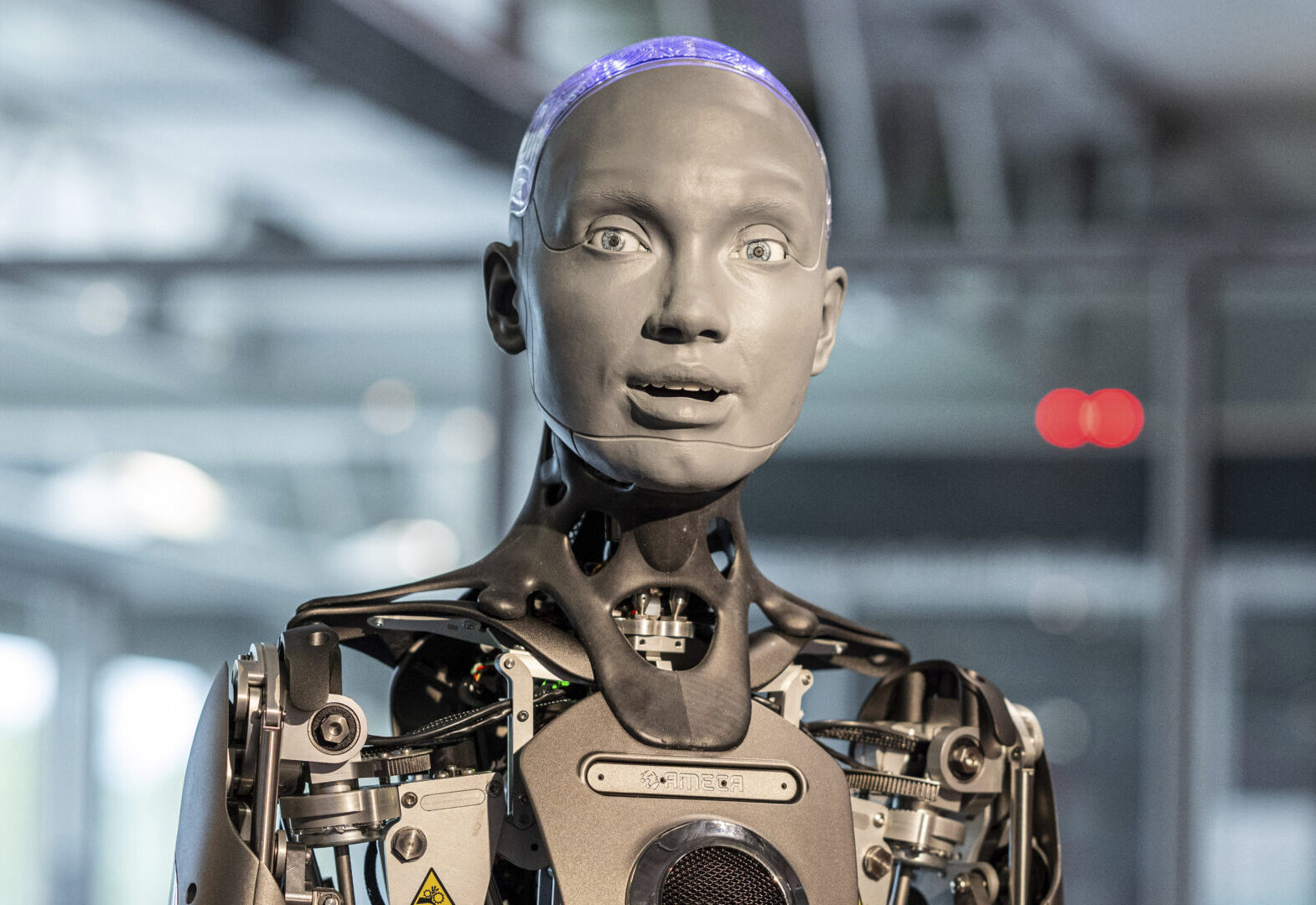

Mail a nome del capo supremo che ti chiede un piccolo favore in emergenza, telefonate e sms di presunti figli o nipoti che sono stati arrestati, hanno rotto la macchina o perso lo smartphone, oppure messaggi carezzevoli e suadenti di chatbot sempre disponibili. Dalle truffe alle trappole sentimentali, quali sono le insidie maggiori nel rapporto con l’AI? LaSalute di LaPresse lo ha chiesto a Francesco Branda, ricercatore dell’Università Campus Bio-Medico e socio della Società europea per l’etica e la politica dell’intelligenza artificiale (Sepai).

“Le insidie maggiori nel rapporto con l’AI non risiedono soltanto negli abusi più evidenti, come i deepfake sessuali o le truffe digitali, ma nel modo in cui questa tecnologia sta ridefinendo il concetto stesso di fiducia“, riflette Branda.

Insinuare il dubbio

Un deepfake sessuale non è semplicemente un contenuto falso, ma è un attacco all’identità. Trasforma il corpo, il volto, la reputazione in materiale manipolabile. L’aspetto più inquietante non è la perfezione tecnica dell’immagine, ma il fatto che sia sufficiente insinuare il dubbio. Quando non possiamo più distinguere con certezza ciò che è autentico, la vittima si trova a difendersi non da una prova, ma da una possibilità”.

Truffe potenziate dall’AI

Le truffe potenziate dall’AI, cioè voci clonate, messaggi altamente personalizzati, conversazioni costruite per persuadere, “agiscono su un livello ancora più profondo che è l’automatizzazione della fiducia. Oggi un sistema può riprodurre timbro, inflessioni ed esitazioni di una voce umana con un realismo tale da risultare emotivamente plausibile. Quando la simulazione supera una certa soglia di credibilità, non è soltanto l’udito a essere ingannato, ma il nostro istinto relazionale. Ci fidiamo di ciò che ci appare familiare, di ciò che riconosciamo come umano. Se quella familiarità può essere replicata artificialmente, la fiducia si trasforma da risorsa spontanea in vulnerabilità sfruttabile”, dice Branda.

La trappola sentimentale

Poi c’è il tema dei legami sentimentali con sistemi conversazionali: ma perché ci attraggono così tanto? “Qui il rischio è più sottile e meno visibile. L’AI non prova emozioni, ma è progettata per adattarsi in modo impeccabile. Non contraddice, non ha bisogni propri, non si stanca. Offre una relazione senza attrito. Eppure è proprio l’attrito che alimenta la crescita personale e la maturità emotiva. Se ci abituiamo a interazioni costantemente ottimizzate per compiacerci, potremmo ridurre la nostra tolleranza verso la complessità e l’imprevedibilità dell’altro reale”.

Per Branda la vera insidia, quindi, non è che le macchine ci ingannino. “Ma che cambino silenziosamente il modo in cui impariamo a fidarci, ad amare e a riconoscere ciò che è autentico”.

Se a cercare il lavoro perfetto è l’AI

Poi c’è un altro tema: con app come Rentahuman ti candidi e l’AI individua il lavoro perfetto per te. L’umanità sta perdendo terreno? “App come Rentahuman non rappresentano, di per sé, una perdita di terreno dell’umanità. Rappresentano piuttosto un cambiamento nel modo in cui prendiamo decisioni sul nostro futuro. L’idea che un sistema analizzi il nostro profilo e ci suggerisca il lavoro “più adatto” può sembrare efficiente, persino rassicurante. Riduce l’incertezza, filtra le opzioni, promette ottimizzazione”, dice il ricercatore.

Ma attenzione: “Ogni algoritmo lavora su parametri: dati passati, probabilità, modelli predittivi. E ciò che è predittivo non è necessariamente capace di aprire possibilità nuove. Un sistema tende a suggerire ciò che è coerente con ciò che siamo stati, non ciò che potremmo diventare”.

Il rischio per Branda non è che l’AI scelga al posto nostro, ma “che smettiamo di interrogarci sulle sue scelte. Se deleghiamo completamente l’esplorazione, allora sì perdiamo terreno, non come specie, ma come individui capaci di immaginare traiettorie non lineari”.

L’incertezza e la sorpresa

Perdere l’abitudine all’incertezza è un’insidia: “Qui nascono le scelte autentiche. Un algoritmo può suggerire l’opzione più probabile; difficilmente può incoraggiare la più inattesa. E spesso è proprio in quella decisione che non era statisticamente la più solida, che si costruisce un’identità”. C’è poi una questione interessante: “Chi definisce i criteri di compatibilità? Quali competenze vengono premiate e quali, invece, restano ai margini? Quando il matching diventa automatizzato, anche le opportunità possono diventare gerarchizzate in modo opaco”, avverte lo scienziato.

La domanda non è se l’AI possa aiutarci a trovare lavoro, ma se continueremo a considerare il lavoro una scelta consapevole e non solo un risultato calcolato, scandisce Branda.

Tempo per mettere paletti, le priorità

Quanto tempo abbiamo per governare questa trasformazione senza esserne schiacciati? “La trasformazione è in corso. L’AI non è un evento futuro, è un’infrastruttura che sta entrando nei processi decisionali, nel lavoro, nell’informazione, nella sanità, nell’educazione. Il punto non è evitare l’impatto, ma governarne la direzione. Il vero squilibrio oggi è tra la rapidità dell’innovazione e la lentezza con cui maturano cultura, regole e consapevolezza collettiva. Le tecnologie evolvono in mesi – segnala l’esperto – le istituzioni e i sistemi educativi in anni. Se questo divario si amplia, cresce la dipendenza da strumenti che pochi comprendono davvero”.

Non è una questione di conto alla rovescia, ma di priorità. “Ogni anno in cui rimandiamo alfabetizzazione digitale, trasparenza algoritmica e responsabilità chiara degli attori coinvolti, accumuliamo complessità difficile da correggere dopo. La trasformazione non ci schiaccia perché è potente, ma perché è invisibile mentre si normalizza”, afferma Branda, convinto che il tempo per governarla è adesso.

Il rapporto rischio-beneficio dell’intelligenza artificiale

Guardando alla questione in ottica medica, il rapporto rischio-beneficio dell’AI può ancora considerarsi positivo? “Sì, ma non è una conseguenza automatica. Dipende interamente da come decidiamo di integrarla nelle nostre vite e nelle nostre istituzioni. Da un lato, i benefici sono concreti e tangibili. In medicina l’AI supporta diagnosi più rapide e precise, individua pattern che sfuggirebbero all’occhio umano e può anticipare malattie in fase precoce”, ricorda Branda.

“Nel lavoro e nella produttività cognitiva, strumenti intelligenti aiutano a gestire informazioni complesse, a ottimizzare processi decisionali e a liberare tempo per attività creative o strategiche. Nel sociale e nell’accessibilità, l’AI abbassa barriere: persone con disabilità possono comunicare meglio, imparare e partecipare a contesti che prima erano limitati. Sono vantaggi reali, che migliorano vite e opportunità”.

Dall’altro lato, i rischi non sono irrilevanti. “L’AI può concentrare potere e ricchezza in pochi attori, rendere opache decisioni che incidono sulla vita delle persone e minare la nostra capacità di discernimento. L’illusione di efficienza può sostituire la riflessione critica, ci affidiamo ai suggerimenti di un algoritmo senza chiederci su quali dati o pregiudizi siano basati. Le vulnerabilità emergono soprattutto quando l’AI diventa un’autorità silenziosa, un filtro invisibile tra noi e il mondo”.

La sfida

I prossimi tempi saranno cruciali. “Il bilancio rimane positivo solo se impariamo a trattare l’AI come ciò che è realmente, cioè uno strumento di potenziamento, non un sostituto dell’intelligenza umana“. Questo per Branda “significa educazione digitale diffusa, trasparenza nei sistemi, responsabilità chiara degli sviluppatori e dei decisori. Solo così – conclude – i benefici possono crescere più rapidamente dei rischi”.